Drucken (Bereits 30 mal) Drucken (Bereits 30 mal) |

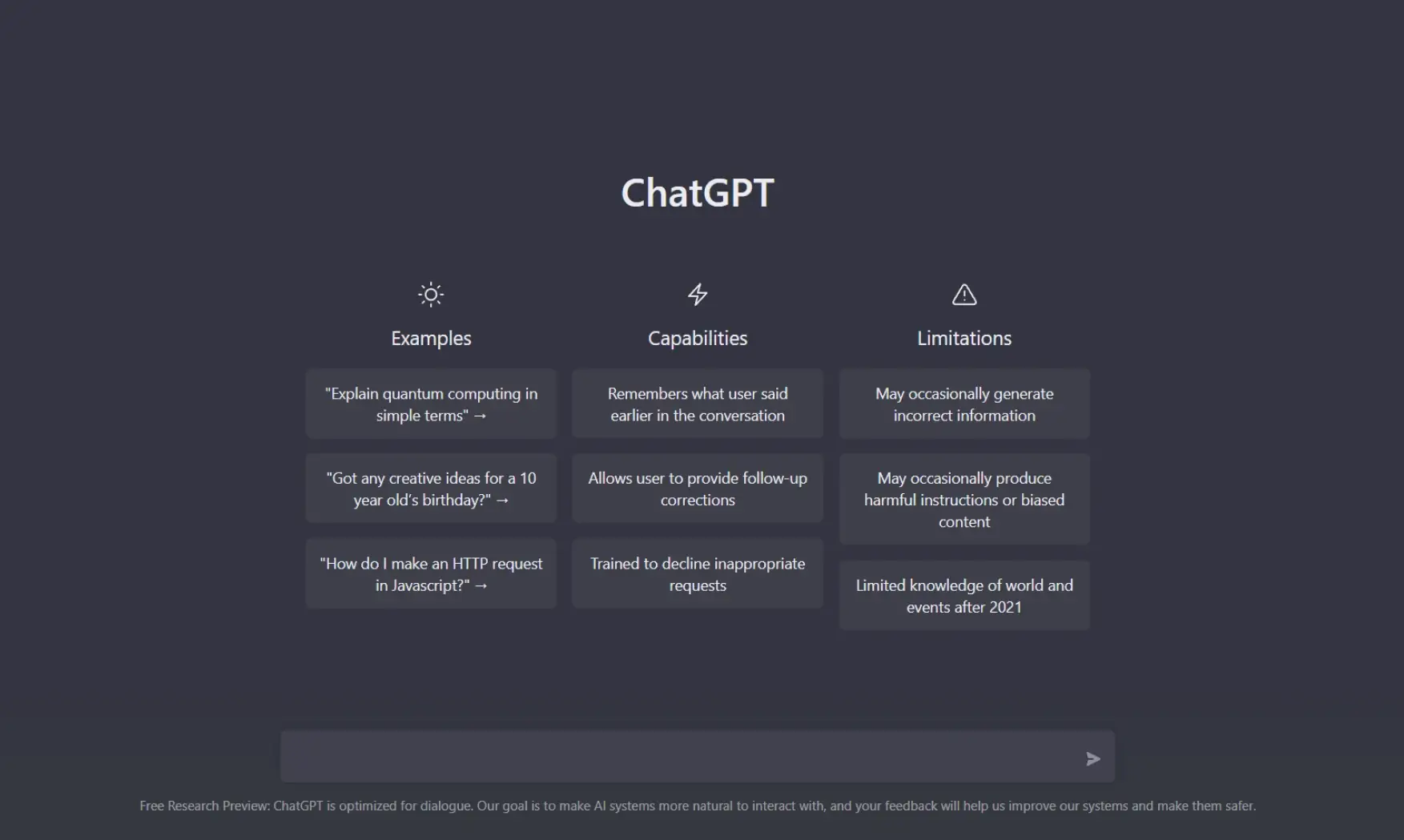

| Das schmutzige Geheimnis von Chat GPT sind kenianische Billiglohnkräfte (21. Januar 2023/10:01)  Bild: Screenshot Für nicht einmal zwei Dollar die Stunde sollen diese der KI beigebracht haben, toxische Inhalte zu vermeiden - und mussten dafür genau diese sortieren Es ist eines der zentralen Probleme bei der Entwicklung von künstlicher Intelligenz (KI): Wie verhindert man, dass diese all die Vorurteile, all den Hass, der im Internet zu finden ist, reproduziert? Dieses Problem des "Bias" stellt sich generell bei allen Formen des Maschinenlernens, bei großen Sprachmodellen wie dem Chat GPT zugrundeliegenden GPT-3 ist das aber besonders virulent. Eben weil hier weite Teile des Internets als Trainingsmaterial verwendet werden, eine Auswahl also nur begrenzt möglich ist. Bei Chat GPT heißt die Antwort darauf: Menschen. Und zwar Menschen, die der KI manuell beibringen, was eine passende Antwort ist und was nicht. So lernt diese nach und nach, was passendes Verhalten ist, tatsächlich neigt der Chatbot von Open AI im Gegensatz zu vielen seiner Vorgängern nicht zu rassistischen oder sexistischen Ausfällen. Das ist erfreulich, hat aber auch eine dunkle Seite, die nun ein Bericht von "Time" offenlegt. Das Training von Chat GPT soll nämlich von der kenianischen Firma Sama vorgenommen worden sein, deren Mitarbeiter dafür dann weniger als zwei Dollar pro Stunde bekommen haben sollen. Vor allem aber sollen sie dafür die dunkelsten Seiten der menschlichen Natur präsentiert bekommen haben.

|

https://ress.at/das-schmutzige-geheimnis-von-chat-gpt-sind-kenianische-billiglohnkraefte-news21012023100128.html

© by RessServerWorks, 2025